GPT-4 : état des lieux et impacts potentiels. Découvrez les dernières avancées de l'IA GPT-4 et ses implications futures dans divers domaines.

%252525252520(1).jpeg)

OpenAI a ouvert au public son puissant modèle de langage d'IA GPT-3 en mai 2020, et le modèle a rapidement fait sensation dans la communauté de l'IA.

GPT-3 est un réseau neuronal formé sur un grand ensemble de données textuelles, et il peut générer du texte de "type humain".

Cela en fait un outil puissant pour des tâches telles que la traduction automatique, le résumé de texte et même la création de nouveaux articles longs à partir de zéro.

GPT-4 arrivé en 2023 et enfin publié sous plusieurs versions (GPT-4 mini ou GPT-4o par exemple)

Alors qu'à l'origine, on disait que le nombre de paramètres pouvait atteindre 100 trillions, Sam Altman, PDG d'OpenAI, a démenti cette information.

%252525252520(1).jpeg)

À première vue, il s'agit d'un nombre relativement faible de paramètres, surtout par rapport à d'autres modèles.

Par exemple, Nvidia et Microsoft ont lancé l'année dernière le réseau neuronal Megatron-Turing, le plus grand et le plus dense jamais réalisé.

Avec 530 milliards paramètres, ce modèle contient de nombreux points de données.

Toutefois, les modèles plus petits ont prouvé que les entreprises n'ont pas besoin d'aller aussi loin pour obtenir d'excellents résultats.

Les modèles plus petits sont bien plus efficaces pour l'apprentissage en quelques étapes, où un modèle peut classer et apprendre à partir d'une quantité limitée de données.

Par exemple, certains affirment que des modèles tels que Gopher ou Chinchilla sont plus performants que GPT-3 pour effectuer diverses tâches, et les entreprises s'en sont rendu compte en développant leurs modèles.

En ce qui concerne GPT-4, nous devrons attendre de voir à quoi ressemble le modèle final à cet égard, mais on peut dire que la société a tiré les leçons des éléments réussis de tels modèles.

Un aspect crucial que les gens ont tendance à oublier lorsqu'ils discutent des modèles d'IA est l'équilibre entre la précision et le coût.

La formation de modèles plus étendus nécessite une quantité incroyable de temps, d'argent et de ressources, car les ressources informatiques qui doivent être consacrées à la préparation de ces grands modèles sont immenses.

Cependant, les résultats ne sont généralement pas bien meilleurs que ceux de modèles plus petits qui peuvent utiliser les données fournies pour s'améliorer.

Par exemple, GPT-3 n'a été entraîné qu'une seule fois sur un ensemble de données et, malgré quelques erreurs, le modèle a pu générer un texte de type "humain".

La recherche de modèles optimaux plutôt que des plus grands modèles sera probablement la voie à suivre avec l'intelligence artificielle.

GPT-4 en sera probablement un bon exemple, et il sera intéressant de voir comment le modèle se comporte une fois qu'il sera finalement publié.

Ces deux concepts font référence au type de données utilisées pour entraîner le modèle.

Un modèle textuel est formé sur, vous l'avez deviné, des données textuelles.

D'autre part, un modèle multimodal est entraîné sur plusieurs types de données.

Il peut s'agir d'images, de vidéos et même de sons.

L'avantage d'un modèle multimodal est qu'il peut mieux comprendre le contexte des données.

Par exemple, si vous montrez une photo de chat à un modèle en mode texte, celui-ci n'a aucune idée de ce qu'il regarde.

Toutefois, si vous montriez la même image à un modèle multimodal, celui-ci sera capable de comprendre qu'il regarde un chat et d'agir en conséquence.

Les avantages d'un modèle multimodal sont évidents, mais l'inconvénient est qu'ils sont beaucoup plus difficiles à former.

Altman a précisé dans un segment de questions-réponses que GPT-4 ne serait pas multimodal (qui est le modèle utilisé par DALL-E et MUM), mais un modèle uniquement textuel.

Encore une fois, cela pourrait être lié au fait qu'OpenAI essaie de rendre le modèle plus efficace - plutôt que plus grand.

Les modèles épars, qui utilisent différentes parties du modèle pour traiter divers types d'entrées, ont récemment rencontré le succès.

Cela pourrait s'expliquer par le fait qu'ils peuvent rapidement dépasser le seuil de 1T-paramètre sans souffrir de coûts de calcul élevés.

Les avantages de la sparsité comprennent également la possibilité de traiter plusieurs types d'entrées et de données.

Cela dit, un modèle clairsemé conduit également à avoir besoin de plus de ressources ; il est donc peu probable que GPT-4 devienne un modèle aussi gros.

Tout porte à croire qu'OpenAI a trouvé un équilibre avec GPT-4 en ce qui concerne la taille des modèles, et il sera très curieux de voir ce que donnera le produit final.

Malgré cela, je ne peux pas envisager un avenir où cela se répète avec d'autres modèles futurs.

Étant donné que le fonctionnement de notre cerveau repose sur le traitement clairsemé et que l'intelligence artificielle est fondée sur l'imitation du cerveau, les futurs modèles pourraient, en fait, fonctionner de cette manière.

Aligner l'intelligence artificielle sur les valeurs humaines est un énorme défi qui n'a pas encore été entièrement résolu.

Alors que GPT-3 était déjà très performant dans ce domaine, on se demande encore comment GPT-4 va s'en sortir.

L'un des principaux problèmes de l'intelligence artificielle est qu'elle ne peut pas comprendre les intentions ou les valeurs.

Il ne peut comprendre que les données qui lui sont fournies.

C'est pourquoi l'accent a été mis sur la création d'une intelligence artificielle axée sur la valeur.

GPT-4 sera probablement un grand pas dans la bonne direction.

Toutefois, il reste des questions fondamentales à résoudre.

La résolution des défis d'un point de vue mathématique et philosophique reste nécessaire pour créer une intelligence artificielle véritablement alignée sur les valeurs.

Cela dit, avec l'engagement d'OpenAI en faveur d'un avenir sain pour tous, GPT-4 sera probablement un grand pas dans la bonne direction.

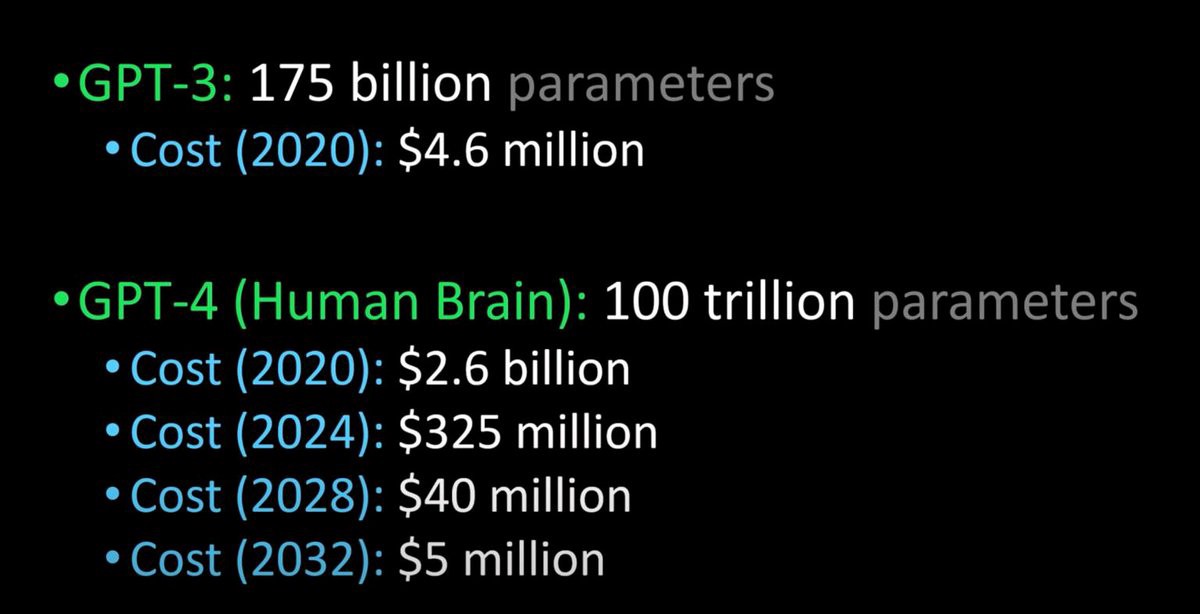

La différence la plus significative de GPT-3 vs GPT-4 est le nombre de paramètres de machine learning.

GPT-3 en utilise jusqu'à 175 milliards, tandis que GPT-4 en utilisera jusqu'à 100 trillions.

C'est environ 500 fois la taille de GPT-3.

Comme je l'ai mentionné précédemment, la taille n'est pas toujours synonyme de qualité pour les modèles d'IA. Il sera donc intéressant de voir comment le produit final se présente.

Les modèles GPT-4 et GPT-3.5 sont des technologies d'intelligence artificielle qui peuvent fournir des réponses complexes et créatives. Des mises à jour sont prévues pour améliorer encore ces modèles.

Voici les points clés à retenir :

GPT-4 est une technologie en évolution qui promet d'améliorer encore la capacité des machines à interagir avec nous et à fournir des réponses plus précises et plus utiles.

GPT-4 est l'un des outils les plus récents et les plus puissants pour le traitement du langage naturel (NLP). Il a été développé par OpenAI, une entreprise de recherche en intelligence artificielle.

.png)

La tarification de GPT-4 commence à 0,03 $ et peut aller jusqu'à 0,12 $ par 1000 jetons selon les exigences. Les jetons peuvent être considérés comme des mots où 1000 jetons représentent environ 13 pages de texte.

OpenAI propose également un abonnement à ChatGPT Plus qui offre l'accès à GPT-4 pour 20 $ par mois.

.png)

Cet abonnement est actuellement limité à 100 messages toutes les 4 heures.

En comparaison, pour 20 $, vous pouvez obtenir un accès illimité à GPT-3 avec une fenêtre contextuelle de 8K.

En conclusion, le prix de GPT-4 varie selon les besoins et le nombre de jetons utilisés. Vous pouvez accéder à cette technologie via un abonnement ou payer au fur et à mesure que vous l'utilisez.

Que vous soyez quelqu'un qui utilise l'internet dans votre carrière, ou simplement quelqu'un qui utilise l'internet pour se tenir au courant de ce qui se passe autour de vous, préparez-vous à voir davantage d'intelligence artificielle dans le contenu que vous lisez sur l'internet.

Pour le premier type d'utilisateurs d'Internet, vous devriez envisager d'utiliser GPT-4 pour automatiser certains de vos processus commerciaux.

De plus, GPT-4 est susceptible d'être intégré dans de nombreuses applications différentes, il est donc essentiel de se préparer à sa sortie.

Voici quelques exemples.

Les créateurs de contenu vont adorer GPT-4. Ce modèle de langage naturel utilise l'apprentissage profond pour comprendre et générer du texte avec une précision remarquable.

L'intelligence générale artificielle (AGI) est au cœur de GPT-4, lui permettant d'apprendre et d'exécuter pratiquement n'importe quelle tâche intellectuelle humaine. Pour les rédacteurs, cela se traduit par :

GPT-4 n'est pas là pour remplacer les rédacteurs, mais plutôt pour amplifier leurs capacités. Il peut servir de collaborateur virtuel, proposant des idées, des ébauches, ou même des corrections stylistiques.

Avec cet outil puissant à leur disposition, les rédacteurs peuvent se concentrer davantage sur la créativité et la stratégie de contenu, laissant les tâches répétitives à leur assistant IA.

Codex, le petit frère de GPT-4 dédié au code, révolutionne le développement. Cette avancée rapproche les développeurs de l'intelligence générale artificielle, ouvrant des perspectives fascinantes.

L'alliance du traitement du langage naturel et des langages de programmation comme Python simplifie considérablement le processus de développement. Les implications sont particulièrement prometteuses dans le domaine de la robotique :

Bien que l'auto-codage des robots reste un objectif lointain, GPT-4 trace la voie vers cette réalité futuriste.

L'IA bouleverse depuis un moment déjà les mondes de l'art et du design. Avec l'arrivée de GPT-4, cette révolution s'accélère encore.

DeepMind, filiale de Google, a déjà montré des résultats impressionnants dans la génération d'art par IA. GPT-4 promet d'aller encore plus loin, offrant aux artistes et designers de nouveaux outils créatifs puissants :

Ces avancées ne visent pas à remplacer la créativité humaine, mais à l'amplifier, ouvrant de nouvelles possibilités d'expression artistique.

Les traducteurs vont découvrir en GPT-4 un allié de taille. Grâce à l'API d'OpenAI, ce modèle linguistique repousse les limites du traitement automatique des langues.

GPT-4 apprend les langues d'une manière étonnamment similaire au cerveau humain. Utilisant un transformateur génératif pré-entraîné, il assimile rapidement d'énormes quantités de données linguistiques. Pour les traducteurs, cela se traduit par :

GPT-4 s'annonce comme un outil révolutionnaire pour surmonter les barrières linguistiques.

Les spécialistes du marketing doivent se préparer à l'arrivée de GPT-4. Cet outil de pointe promet d'automatiser de nombreuses tâches, du balisage à la gestion des chatbots.

Le magazine Wired prédit un avenir où le contenu marketing sera généré par l'IA, et GPT-4 pourrait bien être le catalyseur de cette transformation. Voici ce que cela pourrait signifier :

GPT-4 ne remplacera pas les marketeurs, mais augmentera considérablement leurs capacités et leur efficacité.

Les vendeurs, pionniers dans l'adoption de l'IA, vont trouver en GPT-4 un allié de choix. Cette nouvelle itération promet d'améliorer encore leur productivité.

Le réglage fin des modèles linguistiques de l'IA est crucial dans le processus de vente, permettant des résultats plus ciblés et précis. Avec GPT-4, les vendeurs peuvent s'attendre à :

GPT-4 s'annonce comme un game-changer dans le monde de la vente, offrant aux professionnels des outils pour mieux comprendre et servir leurs clients.

L'arrivée de GPT-4 marque une nouvelle ère pour la science des données. Avec des volumes de données d'entraînement sans précédent, il ouvre la voie à des algorithmes d'une précision inégalée.

Pour les data scientists, GPT-4 représente :

GPT-4 ne se contente pas d'améliorer les pratiques existantes, il redéfinit les possibilités de la data science, promettant des avancées majeures dans la compréhension et l'utilisation des données.

%252525252520(1).jpeg)

Préparez-vous à accéder au puissant modèle GPT-4 avec OpenAI !

Inscrivez-vous sur leur liste d'attente et, en attendant, commencez à explorer le mode Chat et le turbo gpt-3.5 via leur API - les deux offrent des fonctionnalités similaires à celles du site ChatGPT.

.jpeg)

LIRE PLUS : Auto-GPT : C'est quoi ?

Un modèle de machine learning utilise une solution de modélisation du langage pour générer automatiquement du texte en langage naturel.

Qu'il s'agisse de déduire les intentions des utilisateurs ou de générer toutes les copies automatisées dont on a besoin, ces techniques peuvent être utiles pour créer une application d'aide à l'écriture.

Le fait de disposer de plus de points de données peut contribuer à améliorer les performances d'un modèle de machine learning.

Cependant, le fait de disposer d'un trop grand nombre de paramètres peut parfois conduire à un ajustement excessif.

L'adaptation excessive est définie comme un modèle de machine learning qui donne de bons résultats sur les données d'apprentissage, mais qui ne se généralise pas bien aux données non observées.

Cela signifie que l'ajout de paramètres supplémentaires n'améliorerait pas la situation.

Malheureusement, la version GPT-4 n'est pas encore disponible pour le grand public, donc il n'y a pas de chat GPT-4 gratuit ou d'API GPT-4 pour les utilisateurs.

Pour le moment, seuls les développeurs partenaires d'OpenAI ont accès à cette technologie de pointe.

Cependant, il est possible d'utiliser la version précédente, GPT-3.5, pour améliorer votre site web avec l'IA. Les développeurs peuvent accéder à l'API GPT-3.5 pour créer des chatbots et d'autres fonctionnalités IA intéressantes.

Avec les modèles GPT-3 et GPT-4 d'Openai, nous voyons l'intelligence artificielle la plus avancée à ce jour.

Ces nouveaux modèles modifient le paysage de nombreuses industries, créant des opportunités auparavant impossibles.

Avec la possibilité de saisir un langage naturel et d'obtenir un code en sortie, de générer des images en 3D ou même de créer un texte marketing, les applications de ces nouveaux modèles sont infinies.

Bien que la date exacte du lancement de GPT-4 soit actuellement inconnue, je pense que nous ne sommes qu'au début de ce qui est possible avec le machine learning et son impact sur notre vie quotidienne.

Pour en savoir plus : Un chatbot GPT-3 peut être l'un des meilleurs outils de marketing de contenu pour les entreprises qui utilisent des logiciels d'expérience client.

La bonne nouvelle est que la création de chatbots IA avec GPT-3, GTP-4, GPT-5 ou bientôt Google LamDA est relativement simple avec le bon outil. Il est donc essentiel de faire des recherches lorsque vous choisissez l'outil pour votre entreprise.